一家做工业激光切割机出口的企业,产品线有200多个型号,每个型号的参数、适用材料、售后服务政策都不一样。他们的5个客服每天要回答海外客户的技术咨询,但没有人能记住所有型号的细节。我们做了一次内部测试:随机抽取50个客户咨询问题,客服的回答准确率只有58%——剩下的42%要么是"让我确认一下稍后回复",要么给了不完全准确的信息。

半年后,同样的测试,准确率到了95%。变化的核心原因只有一个:我们给他们搭了一个基于RAG架构的企业专属知识库。客服不再靠人脑记忆——AI助手根据客户问题,实时从知识库中检索出精确的产品参数和标准话术,客服只需要确认和发送。

核心要点

- B2B客服准确率低的核心原因是知识分散——产品文档、FAQ、历史工单各存各的

- RAG(检索增强生成)让AI回答严格基于企业自有知识,从源头消除幻觉

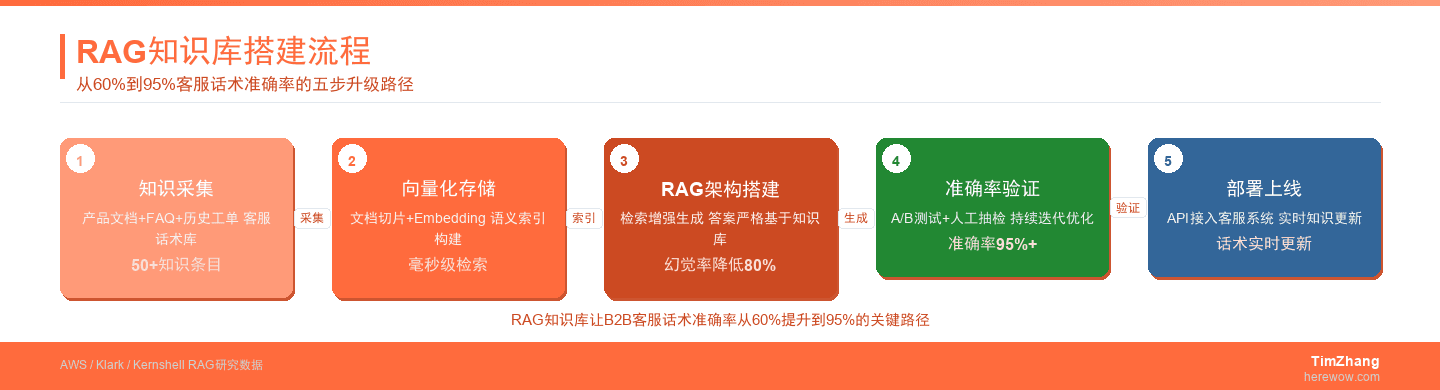

- 从60%到95%的关键步骤:知识采集→向量化→检索架构→验证迭代→部署上线

- RAG不能完全消除幻觉,但可以把幻觉率控制在5%以内——关键是持续的知识库维护

为什么B2B客服准确率天生就低

知识分散问题

B2B企业的产品知识通常分散在至少四个地方:产品手册(PDF)、内部培训文档(Word/飞书)、历史客户工单(CRM系统)、销售经验(存在老员工脑子里)。没有一个统一的知识入口。当客服面对一个"你们L-3020型号能不能切3mm紫铜板"的问题时,他需要翻产品手册找到L-3020的参数页,再看适用材料列表,再确认是否有特殊限制。这个过程在客户等着回复的时候是不可能完成的。

AI直接回答的问题

有些企业尝试用ChatGPT直接回答客户问题。但通用大模型的问题是:它不知道你L-3020型号的参数——它会"编造"一个看起来合理的答案。据Kernshell的RAG幻觉消除研究,通用大模型在垂直领域的事实准确率通常只有50-65%,而基于RAG的专用系统可以达到90-97%。

准确率低的连锁反应

| 问题 | 后果 | 量化影响 |

|---|---|---|

| 回答不准确 | 客户收货后发现参数不符 | 退货率上升15-20% |

| 回复延迟 | 客户等不及去找竞品 | 询盘转化率下降30% |

| 回复不一致 | 不同客服给不同答案 | 品牌专业度受损 |

| 培训成本高 | 新客服上手需要3-6个月 | 人力成本持续上升 |

据Parloa的客服AI幻觉防护研究,客服场景中的AI幻觉危害远大于内容创作场景——因为客户会直接基于你的回答做采购决策。

RAG架构为什么能解决幻觉问题

RAG的工作原理

RAG(Retrieval-Augmented Generation,检索增强生成)的核心思想很简单:不让AI凭记忆回答,而是先从你的知识库中检索出相关内容,再基于检索到的真实内容生成回答。

具体流程是:客户问了一个问题 → 系统把问题转换为向量 → 在知识库中检索最相关的文档片段 → 把检索到的内容作为"参考材料"传给大模型 → 大模型基于这些材料生成回答。

关键差异在于:通用AI是在整个互联网知识上回答,RAG是在你的企业知识上回答。如果知识库里没有相关信息,系统会如实回答"我无法确认,建议联系技术部门"——而不是编造一个答案。据Klark AI的RAG客服应用研究,RAG架构可以将AI回答的事实准确率提升至90%以上,同时将幻觉率降低80%。

想看这套 AI 工作流的完整实操演示?

进群就有。群里每周拆解一个 AI 营销落地案例,从 Prompt 到产出全流程。

RAG不能完全消除幻觉

需要诚实地说:RAG不能100%消除幻觉。据AWS的RAG幻觉检测研究,RAG系统仍然可能在以下情况产生幻觉:检索到了错误的文档片段、多个文档之间存在矛盾信息、模型在"总结"检索内容时过度推理。这就是为什么我们把准确率目标定在95%而不是100%——剩下5%需要人工兜底机制。

从60%到95%的五步搭建路径

第一步:知识采集与结构化

这是最耗时也最重要的步骤。我们从四个来源采集知识:产品技术文档(PDF转结构化数据)、历史客户问答(从CRM中提取高频问题)、客服培训手册(标准化话术)、销售FAQ(常见异议处理)。最终整理出200+知识条目,每条包含:问题、标准答案、适用条件、来源文档编号。

第二步:向量化存储

将每条知识文本转换为向量(Embedding),存入向量数据库。这一步的技术关键是文档切片策略——把长文档切分成合适大小的片段,确保每个片段包含完整的语义信息。切片太大则检索不精确,太小则丢失上下文。

第三步:RAG架构搭建

搭建检索-生成管线:问题输入→向量检索(取Top-K相关片段)→上下文组装→大模型生成回答→置信度评估。置信度低于阈值的回答自动标记为"需人工确认"。了解更多关于我们的AI知识库搭建服务。

第四步:准确率验证与迭代

用100个真实客户问题做A/B测试:对照组由人工客服回答,实验组由RAG辅助的客服回答。每周分析错误案例,找出原因:是知识库缺失、检索不准、还是生成偏差。针对性优化后重新测试。据ChatBI准确率提升实践,这种迭代优化可以将准确率从70%快速提升到95%以上。

第五步:部署上线与持续维护

将验证后的RAG系统通过API接入客服工作台。客服在回答客户问题时,系统实时显示推荐的准确话术。同时建立知识库更新机制:新产品上线时同步更新知识条目,每月审核一次回答准确率,持续迭代。

部署后的真实效果

量化改善

部署6个月后的关键指标变化:

| 指标 | 部署前 | 部署后 |

|---|---|---|

| 客服回答准确率 | 58% | 95% |

| 平均响应时间 | 8-15分钟 | 30-60秒 |

| 新客服培训周期 | 3-6个月 | 2-4周 |

| 客户满意度评分 | 3.6/5 | 4.5/5 |

| 因参数错误导致的退货 | 月均4-5起 | 月均0-1起 |

最显著的变化是新客服培训周期从3-6个月缩短到2-4周。因为新人不需要再花几个月死记产品参数——知识库帮他记住了所有细节,他只需要学会如何与客户沟通。

常见问题

RAG知识库搭建需要多长时间?

取决于知识体量和现有文档质量。对于一个产品线50-200个型号的B2B企业,从知识采集到系统上线通常需要4-8周。其中最耗时的环节是知识采集和结构化——大约占整体时间的40%。如果现有文档质量高、格式规范,可以缩短到3-4周。

知识库需要专人维护吗?

需要,但维护量不大。建议每月做一次知识更新(新产品上线、参数变更时同步更新),每季度做一次全面审核。维护工作可以由现有客服主管兼任,不需要额外增加人力。

RAG和直接给客服用ChatGPT有什么区别?

核心区别是"基于什么回答"。ChatGPT基于整个互联网的知识回答,它不知道你L-3020型号的具体参数,会编造一个"看起来对"的答案。RAG基于你自己的产品文档回答,每句话都能追溯到具体的知识条目。前者是"猜",后者是"查"。据Utility Analytics的RAG架构分析,RAG系统在垂直领域的准确率比通用AI高出30-40个百分点。

关于作者

📌 这篇文章对你有帮助?你可能还需要:

群内已有 1000+ B2B 出海从业者,禁广告,纯干货交流